В современном мире кибербезопасности программы баг баунти (bug bounty) играют ключевую роль в выявлении и устранении уязвимостей в программном обеспечении. Эти программы позволяют компаниям привлекать внешних исследователей безопасности для поиска и сообщения о багах в обмен на вознаграждение. С развитием искусственного интеллекта (ИИ) возникают новые возможности и вызовы, которые могут существенно изменить ландшафт баг баунти. В этой статье мы рассмотрим, как ИИ влияет на программы баг баунти, какие новые возможности он открывает и какие вызовы ставит перед сообществом кибербезопасности.

Искусственный интеллект в баг баунти

Автоматизация поиска уязвимостей

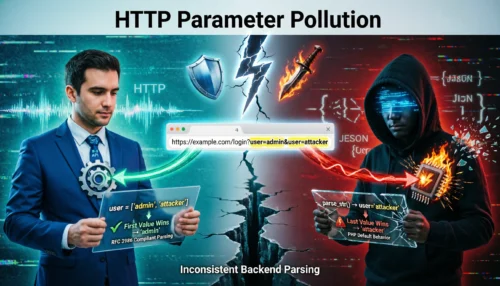

Одним из наиболее очевидных применений ИИ в баг баунти является автоматизация процесса поиска уязвимостей. Современные системы ИИ могут анализировать огромные объемы кода и данных, выявляя потенциальные уязвимости с высокой точностью. Это позволяет исследователям безопасности сосредоточиться на более сложных и специфических задачах, требующих человеческого вмешательства.

Умные инструменты для тестирования

ИИ-инструменты для тестирования безопасности могут значительно ускорить процесс выявления уязвимостей. Эти инструменты используют машинное обучение для анализа паттернов и аномалий в коде, что позволяет быстрее и точнее обнаруживать потенциальные проблемы. Например, инструменты на основе ИИ могут автоматически генерировать тестовые сценарии и проводить фуззинг (fuzzing) для выявления уязвимостей.

Прогнозирование и предотвращение уязвимостей

ИИ может помочь не только в выявлении существующих уязвимостей, но и в прогнозировании потенциальных проблем. Анализируя исторические данные о найденных багах и уязвимостях, ИИ может предсказывать, где и когда могут возникнуть новые проблемы. Это позволяет компаниям заранее принимать меры по предотвращению уязвимостей и улучшению общей безопасности своих систем.

Новые вызовы

Этические и правовые аспекты

С внедрением ИИ в баг баунти возникают новые этические и правовые вопросы. Например, кто несет ответственность за уязвимости, найденные ИИ-системами? Как обеспечить прозрачность и справедливость в процессе вознаграждения исследователей безопасности? Эти вопросы требуют тщательного рассмотрения и разработки новых нормативных актов и стандартов.

Безопасность ИИ-систем

Сами ИИ-системы могут стать целью для атак. Злоумышленники могут попытаться манипулировать ИИ-инструментами для тестирования безопасности, чтобы скрыть уязвимости или создать ложные результаты. Это требует разработки дополнительных мер безопасности для защиты ИИ-систем от подобных атак.

Человеческий фактор

Несмотря на все преимущества ИИ, человеческий фактор остается важным компонентом в процессе баг баунти. Исследователи безопасности приносят уникальные знания и опыт, которые не могут быть полностью заменены ИИ. Важно найти баланс между автоматизацией и человеческим вмешательством, чтобы максимально эффективно использовать возможности ИИ и опыт исследователей.

Искусственный интеллект открывает новые горизонты для программ баг баунти, предлагая мощные инструменты для автоматизации, прогнозирования и предотвращения уязвимостей. Однако с этими возможностями приходят и новые вызовы, требующие тщательного рассмотрения и решения. В будущем, сочетание ИИ и человеческого опыта может значительно повысить уровень кибербезопасности и эффективность программ баг баунти.